A la memoria de Hideo Matsushita. (Tokio, Japón)

“Cualquier obtención de energía sin un gasto correspondiente de energía es absolutamente imposible”, Rudolf Clausius. 1822.

CADENA AUDITIVA :

Las ondas mecánicas producidas por un Emisor viajan a través del aire, que es el

Medio elástico y gaseoso en el cual estamos sumergidos, transportando la

información hasta llegar al Receptor.

Estos tres eslabones tienen que existir en toda cadena de audio. Y cómo dicen por

ahí, “La cadena se corta por el eslabón mas débil”.

Ahora bien, nuestro emisor ya provocó las perturbaciones de presión en el aire, y el

medio nos transporta dicho estímulo sonoro hasta el receptor. El proceso es

sencillo pero el resultado final no siempre es el mejor.

Desde la idea prima del emisor a la percepción final del receptor pasando por el

“asesino“ medio (aire), casi seguro que algo de este estímulo se ha modificado.

Es decir, desde el primer momento en que el emisor produce perturbaciones en el

medio, ya pierde parte de esa energía inicial por la necesidad de cambiar su

inercia mecánica, que está en estado de reposo. El aire nos cobra un peaje muy

caro para su traslado, tiene una pérdida de energía muy grande a la distancia

(Teoría cinética de los gases y la ley inversa del cuadrado). Como así también su

temperatura y su humedad son factores importantísimos a tener en cuenta, ya que

estos modifican mucho las características particulares de la presión sonora.

En la actualidad con los avances tecnológicos y científicos en el estudio de la

acústica, la psicofísica y la psicoacústica, tenemos la posibilidad de controlar mucho

la parte física de dicha presión sonora en el medio en que se desarrolla. Cómo es el

caso cuando necesitamos calibrar, ajustar y acoplar nuestro sistema electrónico de sonido con la acústica del recinto. Dicho proceso de acoplamiento, cómo dijo Bob

Mc Carthy es lo más difícil de lograr.

El único parámetro natural que aún no podemos controlar es el viento (al aire libre

lógicamente), contra esto no se puede hacer absolutamente nada, no existe en la

acústica moderna la posibilidad de luchar contra el viento.

En cambio para la temperatura y humedad existen algoritmos que solucionan el

problema típico que cuando hacemos pruebas de sonido por la tarde con una

temperatura y humedad determinadas, y por la noche en el concierto estos

parámetros varían considerablemente. Gracias a estos algoritmos podemos re-

calcular la calibración del sistema sonoro y reajustarlo para su balance armónico

tonal.

Recuerdo una anécdota de hace muchos años atrás, cuando todavía no existían

estos algoritmos que venimos hablando, el técnico de una banda muy importante y

conocida mundialmente, durante las pruebas mandó a poner en marcha la

calefacción del predio (Luna Park, Buenos Aires) para simular la temperatura a la

hora del concierto. El resultado fue genial, así como la idea.

También hay que tener en cuenta que el emisor no siempre transmite algo, es decir

si escuchamos a un avión, que dicho sea de paso, que por una cuestión acústica de

reflexiones encontradas no es fácil saber exactamente su procedencia, no nos

transmite nada, no nos quiere decir nada. Simplemente pasa por ese lugar, no te

dice “Hola, soy un avión, te gustan mis alas? ”, ya sabemos que es un avión por

una cuestión cultural, pero no podemos reconocer su color o marca o compañía

aérea, con solo escucharlo. A esto se lo conoce cómo “Escucha Pasiva “

Con lo cual podemos decir que ”Emitir no es transmitir”.

Y otra salvedad es que “Oír no es escuchar”.

Con esto quiero decir que no siempre uno escucha lo que oye. Tenemos filtros que

eligen cuál de los estímulos recibidos es el importante. O sea que podemos filtrar el

mensaje final para su percepción, y los otros estímulos son solamente sensaciones.

“Oír es una acto involuntario. Escuchar es un acto intencional”.

RECEPCIÓN / PERCEPCIÓN :

Existen para la recepción del estímulo sonoro, dos herramientas de vital importancia

para el mundo del sonido.

Dichos receptores son el oído humano y el micrófono.

- Aún siendo verdad que ambos son mecano-transductores, son disímiles entre ellos.

El punto más importante de la diferencia entre estos dos transductores es que el

Oído es un instrumento bio-mecánico y el Micrófono es un instrumento puramente

mecánico.

El oído convierte energía mecánica en impulsos nerviosos (bio-eléctricidad). Que

aún siendo impulsos eléctricos dista mucho de la energía eléctrica, que transduce

un micrófono, que convierte la energía mecánica en energía eléctrica.

Está pequeña gran diferencia es de inicio clave para marcar la distancia que existe

entre ellos.

“Aunque en definitiva, siempre terminaremos utilizando el oído como instrumento receptor. Detrás de un micrófono hay una oreja”.

SISTEMA AUDITIVO :

Nuestro “gran sistema auditivo” está dividido en dos partes:

El sistema periférico.

És el responsable de los procesos fisiológicos de la audición. La “sensación”

propiamente dicha. Es la parte física del oído, estudiado a través de la psicofísica.

Digamos la parte “hardware”, la parte mecánica podríamos decir. Compuesto por

el oído externo (pinna o aurícula y canal auditivo), el oído medio (tímpano y

osículos) y oído interno (cóclea y neurotransmisores).

2. El sistema central.

És el responsable de los procesos psicológicos de la audición. La “percepción”. Es

la parte psicológica, estudiada por la psicoacústica. Digamos la parte “software”.

Es decir, cuando una persona escucha algún sonido, este llega al oído como una

onda acústica mecánica (estimulo distal), pero dentro del oído humano se

transforma en impulsos eléctricos neurológicos (bioenergía), que pasando por el

mesencéfalo y el diencéfalo llegan a la corteza auditiva ubicada en el lóbulo

temporal y ahí es donde se hace consciente la percepción (estimulo proximal).

La percepción es un conjunto de procesos mentales mediante el cual una persona

selecciona, organiza e interpreta la información proveniente de estímulos,

pensamientos y/o sentimientos, a partir de su experiencia previa, de manera lógica

y/o significativa.

Los procesos de un pensamiento que operan en la mente no se efectúan sobre los eventos en sí mismos, sino sobre la representación que el oyente puede construir a partir de dicho estímulo. Un ejemplo de esto son los efectos:

- Doppler

- Shepard

- Mc Gluck

Entre otros tantos efectos e ilusiones auditivas. (Yanni-Laurel)

“Los sentidos son el mecanismo fisiológico de las sensaciones, mientras que la percepción es la parte psicológica de dichas sensaciones”.

En el momento de recibir los estímulos sonoros, los procesos psicológicos de la

percepción no existen en un micrófono. Es decir, un micrófono solo posee una de las partes. Sería el hardware, el sistema periférico, donde solo lo mecánico está en juego.

Es verdad que a través de la parte hardware, los micrófonos tienen sus

características particulares. De ahí que existan tantos tipos y modelos específicos

para cada determinado tipo de estímulo sonoro que deseamos captar.

Pero no tiene la parte software, la parte psicoacústica es decir la percepción.

”Un micrófono RECIBE pero no PERCIBE”.

Un micrófono no tiene la capacidad de poder elegir de todas los sonidos que recibe,

cuál es prioritario para la percepción final. El recibe todas las vibraciones que se

mueven alrededor de su cápsula, de acuerdo a su sensibilidad, posición, filtros

etc…sin distinguir cuál es cuál.

Un ejemplo claro de esto es;

Si estamos escuchando una orquesta y ponemos nuestra atención a un instrumento en particular y nos centramos en escuchar solo ese instrumento, nuestro cerebro pondrá un filtro al resto de la orquesta y dejará como percepción más importante a nuestro instrumento elegido (recomiendo leer sobre ancho de banda critica y/o enmascaramiento). Efecto Cocktail Party (C.Cherry, 1953).

El sistema auditivo humano nos permite localizar y “focalizar” una fuente entre varias similares a ella dentro de un espacio sonoro. Dicho de otra manera, podemos encontrarnos en una reunión y, con todo el mundo hablando a la vez, somos capaces de centrarnos en una voz en concreto y escucharla, aun cuando comparten la misma banda de frecuencia.

El apoyo visual de la fuente también ayuda mucho a la localización de la percepción, volviéndose costosa si tenemos un apoyo visual nulo. Se trata de un efecto que tiene que ver más con el cerebro y cómo procesa la información, que con la audición propiamente dicha, ya que no se trata de un indicio únicamente auditivo, si no que necesita un apoyo visual para que se dé correctamente. Esto es conocido como “Percepción transversal”.

“Aunque el oído sea una exquisita máquina mecánica biológica, nos miente más de lo que creemos y la razón muchas veces termina determinando la percepción al estímulo”.

TRANSDUCCIÓN :

Un transductor es un dispositivo capaz de transformar o convertir una determinada

manifestación de energía de entrada, en otra energía de salida.

Denominamos transducción auditiva, a la transformación de la energía mecánica

que actúa sobre los células ciliadas en energía bioeléctrica que, tras la transmisión

sináptica, induce la aparición de un potencial de acción en el nervio coclear.

La audición implica cuatro tipos de transducciones distintas :

1- de ondas sonoras (presión de aire) a vibraciones mecánicas.

2- de vibraciones mecánicas a ondas líquidas.

3- de ondas líquidas a señales químicas.

4- y finalmente de señales químicas a impulsos de bioenergía.

El proceso de transducción tanto en la cóclea como en los receptores vestibulares

depende del ciclo del potasio. Este elemento es de fundamental importancia para la

audición. (¿donde viste a un mono con audífonos ?)

En el caso de un micrófono tiene dos transducciones :

1- de ondas sonoras (presión de aire) a vibraciones mecánicas.

2- de vibraciones mecánicas a señales eléctricas. O en sistema binarios en el caso

de micrófonos digitales .

PROTECCIÓN :

En el caso de estar expuesto a altas presiones sonoras, se activan en el sistema

auditivo alarmas cuya acción es “reducir la función de transferencia entre el oído

externo con el interno”.

Por ejemplo cuando el aire del medio ambiente está comprimido, como sucede

durante el despegue de un avión, el aire del oído medio también lo está y se nos

“tapan” los oídos. Entonces la trompa de Eustaquio, que es una válvula que sirve

para igualar la presión externa con la presión interna de la cavidad del tímpano, se

abre y el aire comprimido se va por ella, compensando la diferencia de presión.

Sucede lo mismo cuando estamos sometidos a la presión de fluidos. Se compensa

la presión para evitar el barotraumatismo. Gran maniobra Dr. Valsalva.

Todo sistema físico mecánico (como es el oído) que está sometido a presiones tiene

un punto de ruptura. Sea en un nivel más alto o más bajo, sea por fatiga, desgaste o

resonancia… Pero se rompe. Un ejemplo de esto último es el puente de Tacoma.

Con lo cual recomiendo no clavarse un destornillador en el canal auditivo o bien

no meter la cabeza dentro de un bombo sonando, como si el oído fuese un

micrófono, porque el resultado sería que tendrías que aprender a leer los labios.

El ser humano posee un sistema de protección natural, que nos ayuda a controlar el nivel de intensidad de recepción y así evitar posible ruptura de nuestros oídos, como por ejemplo si estamos mucho tiempo sometidos a un alto nivel de presión sonora. Un arco reflejo neural controla la contracción de los músculos del oído medio, básicamente el músculo estapedial (en algunos casos la membrana timpánica también se tensa). Dicha contracción incrementa la rigidez de la cadena osicular lo que limita su amplitud de desplazamiento, lo que conlleva a una reducción de la energía cinética transmitida al oído interno. Este reflejo estapedial es el que “reduce la función de transferencia” entre el oído externo y la cóclea, dentro de sus límites claro está, como protección ante una posible ruptura.

Por otro lado, la membrana basilar comienza a “aplanar” la respuesta en frecuencia,

para proteger a las células ciliadas en el proceso de despolarización de la sobreestimulación, provocando también una reducción de transferencia. Esto queda

demostrado en las curvas isofónicas. (Fletcher y Munson)

Cada una de las cuatro transducciones, que utiliza el sistema auditivo para la

recepción son importantes en el momento de proteger al oído:

1.-El cerumen, al producir mayor segregación, en una pequeña parte, ayuda a

disminuir el diámetro del canal auditivo y reducir el movimiento de la membrana

timpánica.

2.-El músculo estapedial provoca menor movimiento mecánico (reflejo estapedial ).

3.-Menor movimiento mecánico produce menor movimiento de líquidos (perilinfa

/endolinfa) de las 3 rampas de la cóclea (vestibular, media y timpánica).

4.-La membrana basilar a través del haz olivococlear relajan las células ciliadas

(inyecta inhibidores – Aceticolina) provocando menor potencial de acción lo que da

como resultado menor bioenergía transducida.

Esta “idea “ de controlar la “Entrada”, para optimizar y/ o proteger la “Salida”, es el

funcionamiento de un proceso de control dinámico. En el mundo del sonido los

dispositivos electrónicos que controlan la dinámica son conocidos como “Compresores”.

“Desgraciadamente el oído trabaja con Ataque y Release muy lentos. Y en

modo RMS y no Peak”.

El micrófono no posee un controlador de presión, no tiene ningún tipo de protección

mecánica. Si recibe más presión que la que puede soportar mecánicamente, se

rompe. Se rompe la cápsula, diafragma o membrana cómo lo quieras llamar. No

tiene como el oído un “compresor “ para evitar su ruptura.

Lo que sí, en algunos casos, traen controladores de rango dinámico, atenuadores

electrónicos y/ o filtros de frecuencia, pero para la señal eléctrica transducida, no

para disminuir la presión mecánica que recibe la cápsula.

Demás está decir, que existen diferentes tipos y modelos de micrófonos de acuerdo

al nivel de presión que vamos a captar.

Links recomendados

LOCALIZACIÓN :

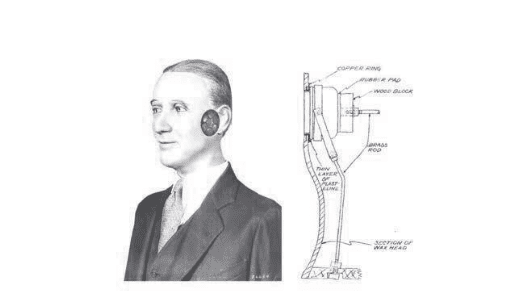

El posicionamiento espaciado de nuestros oídos en los lados opuestos de nuestra

cabeza proporciona un sensor espacial automático.

El ser humano posee un sonar personal biológico que le indica la posición exacta

de donde proviene el sonido que ha recibido (con un error de 3-4 grados) .

Esto es gracias a las diferencias interaurales específicas entre los parámetros

Intensidad (ILD) y Tiempo (ITD), que es lo que utiliza el cerebro para localizar la

posición exacta de dicho estímulo. (Ley de Huygens, Curvas isofónicas y Efecto

Haas).

En el plano sonoro horizontal, llamado azimut, eje X, la referencia de Intensidad

(ILD) y Tiempo (ILD), entre ambos oídos determina la posición del estímulo.

Cualquiera de estos factores por sí solo puede ser determinante para crear la

percepción de localización horizontal. En este caso los oídos están trabajando

conjuntamente, uno depende del otro. Escucha Binaural.

En el plano vertical, el zenit, eje Y, juega un papel muy importante el oído externo.

Este se encarga de conducir a los sonidos hacia el canal auditivo. Acá las ondas

esféricas o omnidireccionales se transforman en ondas planas. Y allí se generan

ondas estacionarias produciendo filtro para algunas frecuencias, a esto sumado los

pelos, el cerumen y la longitud del canal auditivo (condición particular para cada

individuo). Cambiando así el componente espectral (el timbre).

Dicha tonicidad se decodifica en el cerebro proyectando la imagen en el eje Y

vertical. A este proceso se lo conoce como función de transferencia relativa a la

cabeza (H.R.T.F.). Esto es muy pero muy interesante de ver por qué acá está la

magia del sonido 3D o sonido inmersivo.

En este plano de localización los oídos trabajan por separado y no realizan

comparativas entre ellos. Sino que éstos son totalmente independientes uno del

otro. Escucha Monoaural.

Otro papel que juega la pinna o pabellón auricular, con sus complejas geometrías

particulares, es el de proporcionar la localización frontal y trasera, eje Z.

El mecanismo que utiliza es su propia arquitectura anatómica la cual proporciona

algo de direccionalidad en altas frecuencias y añade otra capa de H.R.T.F. a la

ecuación. Y obviamente la resistencia apantallada de la anatomía de las orejas

también cambian la tonalidad y la intensidad.

El ser humano recuerda a lo largo de su vida una gran variedad de funciones de

transferencia correspondientes a las diferentes direcciones de donde proviene el

estímulo sonoro, generando una organización tonotópica de la corteza auditiva,

también conocida como “mapa tonotópico”. Debido a este fenómeno, existen mapas

de frecuencias que indican exactamente qué zona de la corteza auditiva del cerebro

se dedica a unas frecuencias sonoras en concreto. Esta región del cerebro,

mediante la interpretación de los datos obtenidos por el oído, es capaz de localizar

de dónde provienen los sonidos y además identificarlos y clasificarlos. Dando un

factor más que importante para la localización en el eje Z.

Al igual que en el eje Y, en el eje Z los oídos trabajan por separado y no realizan

comparativas entre ellos.

También cabe destacar que la binauralidad mejora la percepción del sonido en

alrededor de 8 dB con respecto a las situaciones de audición con un solo oído.

En el sentido de la localización auditiva juega un papel muy importante el espaciado

interaural y la morfología del oído externo. Y como veremos más adelante, la

resonancia ósea tanto de la cabeza como del tórax, son factores que no posee el

micrófono.

Ahhh…Un dato curioso sobre los músculos extrínsecos auditivos que son

remanentes de etapas evolutivas anteriores, en la actualidad no podemos moverlos

de forma voluntaria, ya que el músculo auricular posterior paso a un estado

vegestal. Es decir que actualmente sólo rotamos la cabeza para buscar localizar la

fuente sonora, y no movemos la pinna de forma voluntaria, cómo otros mamíferos.

¿Cómo se comporta un micrófono ante la localización espacial ?

Un micrófono al ser un instrumento mecánico recibe todas las presiones de aire que

están dentro de su rango dinámico, de acuerdo a su “sensibilidad”, y de su diagrama

polar de captación (algunos mic. poseen la capacidad de modificar su gradiente

polar) etc pero no nos da la localización del emisor.

Lo que sí podemos percibir de la recepción del micrófono es la sumatoria de

reflexiones, indicándonos más bien en el tipo y características del recinto o lugar

donde se producen las perturbaciones que la posición de donde procede el

estímulo.

Si deseamos lograr el reconocimiento posicional de un estímulo, a través de

micrófono, necesitamos más de uno. Técnica conocida como sistema de array o de

matriz. Y hay diferentes sistemas para ello, tales cómo array esféricos, circulares

planos, y otros.

Existen muchos formatos de disposición de los micrófonos para las distintos tipos de

captaciones, como por ejemplo :

- Técnica del par espaciado.Técnica de par coincidente.

- Técnica de par XY. Técnica Blumlein.

- Técnica de Medio-lateral.

- Técnica de par casi coincidente.

- Sistema ORTF.

- Sistema NOS.

- Sistema OOS.

- Doble MS. Array envolvente cardiode (ancho ).

- Ambisonic (orden superior).Fudaka tree

Y sin olvidar la mítica Decca tree.

Incluso grandes empresas tienen dentro de su catálogo micrófonos especiales para

tal efecto. Como por ejemplo :

- Neumann KU 100

- 3Dio FS ProII

- DPA 5100,

- Soundman Dummy Head

- Sennheiser Ambeo MIc

- El sistema Kinect de Xbox.

Dato interesante a tener en cuenta (y fuera de contexto) es que existe una técnica

digital de representación de audio espacial, caracterizada por la creación de

entornos acústicos virtuales, llamada síntesis de campo de ondas (WFS) esta

produce frentes de ondas artificiales sintetizados a partir de ondas elementales. (Ley

de Huygens)

Por lo tanto, cualquier campo sonoro puede reconstruirse si se restablecen la

presión sonora y la velocidad acústica en todos los puntos de la superficie de su

volumen. Este enfoque es el principio subyacente de la holofonía.

Links recomendados

¿Cómo escucharía Van Gogh?

RESONACIA ÓSEA :

El cráneo y el tórax son un tipo de “resonador”, que aportan una vía de estímulo

sonoro más al cerebro como un factor de comparativa para la localización exacta del

estímulo. Esto lo podemos comprobar colocando los dedos índices en sus

respectivos oídos, tapando la entrada al oído medio y solo escuchamos nuestra

resonancia craneal.

O bien poniendo la mano sobre el pecho, donde notaremos la vibración de nuestra

voz. A esto debemos sumarle, otros ruidos internos tales como la respiración y la

pulsación cardíaca que también se suman al factor perceptual de los estímulos

distales.

Con lo cual, nos lleva a pensar que nosotros mismos al tener naturalmente

incorporado filtros y niveles de ruido interno, estos influyen y condicionan en el

resultado totalmente objetivo y personal de la percepción a un estímulo sonoro en

forma única.

Dicho sea de paso, son factores que un micrófono no posee.

EQUILIBRIOCEPCIÓN :

Otra virtud que posee el oído es que juega un papel determinante en nuestro

equilibrio físico. La “equilibriocepción” consiste en que el cuerpo encuentra su equilibrio con

respecto a la gravitación, la aceleración y otras fuerzas que afectan a su posición y

movimiento. Esto es gracias al sistema vestibular (oído interno) en donde se

encuentran los órganos utrículo y sáculo, en forma de cámara llena de perilinfa y

perpendiculares entre si. Estos se encargan de detectar las aceleraciones lineales y

la posición de la cabeza, el utrículo en el plano horizontal y el sáculo en el vertical.

Por otra parte, los canales semicirculares detectan las aceleraciones angulares

que se producen en la cabeza. La ventilación del oído medio y el equilibrio de

presiones, es esencial para una correcta conducción de las vibraciones auditivas

hacia el laberinto.

La información se procesa comparando la señal que se recibe de ambos oídos, ya

que con la presencia de movimiento se va a producir un aumento o disminución de

la señal que estos emiten, es decir, ante un movimiento hacia la izquierda de la

cabeza se produce un aumento de la señal desde el oído izquierdo y una

disminución del derecho. Y viceversa.

Este, llamado Reflejo vestíbulo-ocular, cuyas propiedades dinámicas parecen

menos adaptadas a la gama de bajas frecuencias (0.1 a 4 hz), y otras informaciones

sensoriales (visuales entre otras) son las que contribuyen a mejorar la ganancia.

Este es tomado en cuenta para la construcción de audífonos y en la actualidad para

los sistemas I.E.M.

Y también dicho sea de paso, esta acción un micrófono no la posee.

Los oídos humanos, aun siendo de la misma marca y del mismo modelo, no

siempre responden de la misma manera, sus curvas de respuesta frecuencial y los

umbrales dinámicos suelen ser diferentes entre ambos oídos .

Y todo lo contrario con dos micrófonos de la misma marca y mismo modelo

seguramente tendrán las mismas curvas y características, y de eso se trata.

Grandes marcas como Schoeps, DPA o Brüel & Kjaer buscan que un mismo modelo

de sus micrófonos mantengan rigurosamente la misma similitud, incluso se calibran

para tal efecto.

“Cuando se mide presión sonora con micrófonos, es necesario ponderar las mediciones para hacerlas más cercanas a la escucha humana. Poniendo en claro que un micrófono no es un oído.”

En definitiva en lo único que son análogos un oído y un micrófono :

1.- es que ambos son dispositivos ”mecano- transductores” por lo dicho al inicio de

esta nota.

2.- y en que nunca descansan. Siempre están activos. Y aún que no nos vendría

nada mal tener algún esfínter o pinna retráctil que podamos activar en ciertos

momentos álgidos, algo así cómo el on/ off de un micrófono (el cuál solo funciona

para la parte eléctrica). Pero que gracias a esa actividad imparable de la audición el

ser humano desde sus inicios ha podido sobrevivir y salvarse de grandes peligros.

”Ya podés tener todos los equipos que quieras, pero si no sabés lo que escuchás no llegarás muy lejos”. Webster Tileston

Axis Audio .

Espero que les sirva.

Un saludo y hasta la próxima.

Sergio Cocirio

Jefe de Estudios

Artículo original en Wavesound Academy: